IA e direitos autorais é um assunto que emerge como um dos debates mais acalorados no encontro entre tecnologia e propriedade intelectual.

Empresas de inteligência artificial treinam seus modelos com um volume de dados gigantesco, frequentemente extraídos de obras protegidas, o que levanta acusações de violação de direitos autorais. Casos recentes envolvendo autores, editoras e veículos de comunicação destacam como o avanço da IA desafia as leis, gerando processos judiciais e demandas por regulamentações mais claras.

Com o crescimento exponencial de ferramentas generativas como ChatGPT e Claude, entre outras, vários criadores argumentam que suas obras são exploradas sem compensação, enquanto desenvolvedores defendem o treinamento como essencial para inovação.

Em 2025, decisões judiciais nos Estados Unidos começaram a moldar o panorama, com vitórias parciais para ambas as partes em disputas sobre uso justo. Essa tensão expõe questões legais e éticas sobre o equilíbrio entre progresso tecnológico e proteção à criatividade humana.

O Treinamento de Modelos de IA e as Fontes de Dados

Empresas como OpenAI, Meta e Anthropic dependem de conjuntos massivos de dados para aprimorar suas tecnologias. Esses datasets incluem textos, imagens e áudios, muitos dos quais protegidos por direitos autorais. A prática levanta diversas questões, pois o treinamento envolve a utilização de conteúdos sem remuneração aos criadores originais.

Nos Estados Unidos, ações coletivas acusam gigantes da tecnologia de usarem quase 200 mil livros sem permissão, argumentando que isso configura roubo intelectual. Artistas visuais também processaram ferramentas como Stable Diffusion e Midjourney por replicarem estilos sem consentimento, ampliando o panorama para além de textos.

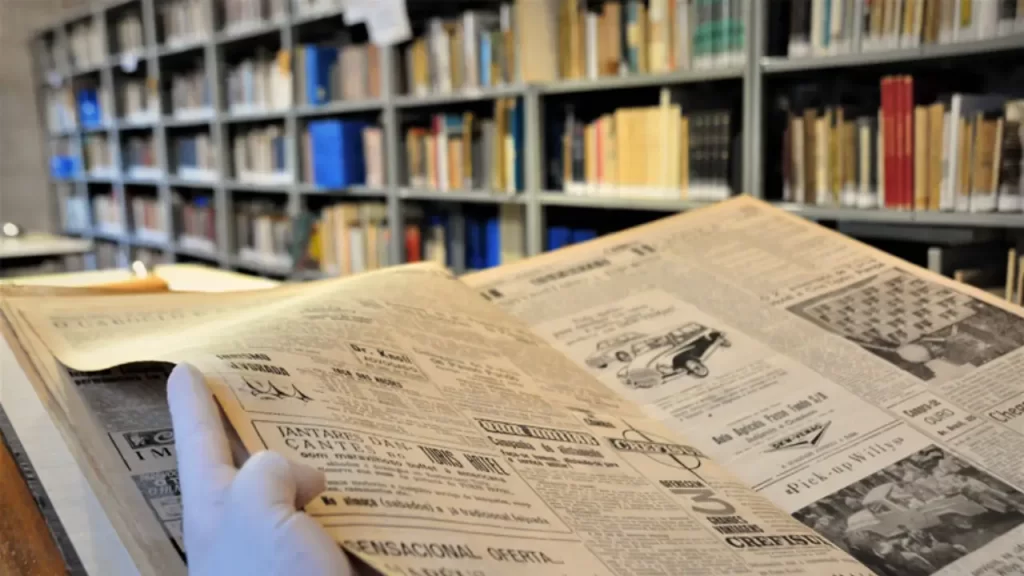

O processo de treinamento de modelos de grandes modelos de linguagem (LLMs) envolve o scraping de dados da web, bibliotecas digitais e repositórios, frequentemente sem licenças explícitas. Relatórios do US Copyright Office em 2025 destacam que a maioria dos conteúdos é usada sem autorização, embora alguns detentores de direitos optem por licenciamentos.

Essa dependência de dados massivos é justificada pelas empresas como necessária para melhorar precisão e versatilidade, mas isso pode gerar um risco de diluição do valor econômico das obras originais. Além disso, a falta de transparência sobre as fontes de dados complica auditorias, deixando criadores sem meios para rastrear usos indevidos.

Uso de Obras de Escritores Famosos no Treinamento

Autores renomados veem suas criações incorporadas a modelos de IA sem autorização explícita. No Brasil, obras de Paulo Coelho, Chico Buarque e Clarice Lispector foram identificadas em datasets usados por empresas americanas para treinar chatbots como o LLaMa da Meta e o Claude da Anthropic. Esses exemplos ilustram como textos literários clássicos alimentam algoritmos, permitindo que IAs gerem conteúdos semelhantes em estilo ou tema.

Internacionalmente, escritores como Stephen King, Haruki Murakami, Nora Roberts e John Grisham tiveram livros incluídos em investigações, revelando o uso sistemático de obras premiadas para aprimorar capacidades linguísticas de IAs.

A controvérsia vai além do mero uso, muitos autores argumentam que isso dilui o valor de seu trabalho, transformando criações únicas em matéria-prima massificada e descartável. Em ações judiciais, eles defendem que o treinamento não se qualifica como “uso justo” sob leis de direitos autorais, pois resulta em produtos comerciais que competem diretamente com o mercado editorial.

No mundo editorial, as editoras brasileiras já detectam originais de livros gerados por IA, com indícios em até 60 obras de 900 recebidas em concursos recentes, sinalizando uma inundação de conteúdo automatizado que pressiona autores humanos. Além disso, o impacto se estende a indústrias criativas globais, com autores australianos descobrindo mais de mil títulos piratas em datasets como Books3, usados por corporações para treinamento de suas IA’s.

Essa prática além de afetar o pagamento de royalties, levanta debates sobre a autenticidade do futuro da literatura, onde IAs podem replicar vozes únicas sem inovação genuína, gerando uma cópia mal feita.

Recurso a Livros Piratas como Fonte de Dados

Muitos datasets de treinamento provêm de fontes ilegais, como bibliotecas digitais piratas. O conjunto Books3 contém mais de 183 mil livros obtidos via torrent, incluindo cópias não autorizadas de autores brasileiros e internacionais. A Meta admitiu o uso de porções desse dataset para treinar seus modelos LLaMa, enquanto a Anthropic incorporou materiais semelhantes no desenvolvimento do Claude.

Esses casos expõem o uso de materiais ilícitos para contornar custos de licenciamento, prática destacada em processos judiciais nos EUA. Diversos escritores processaram a Microsoft por usar quase 200 mil livros piratas no algoritmo Megatron, alegando violação em massa. No Brasil, investigações revelaram que obras de Clarice Lispector e Paulo Coelho foram incorporadas a esses conjuntos, alimentando modelos sem pagamento de royalties.

As empresas donas das IA’s defendem que o treinamento transforma os dados, não os copia diretamente, mas em decisões de 2025 nos EUA, vários juizes classificaram isso como uso justo em alguns contextos, intensificando o debate global.

Essa utilização de conteúdos piratas viola leis e compromete a qualidade dos modelos, pois inclui versões adulteradas ou incompletas de obras.

Acordos e Iniciativas para Mitigar Violações

Diante das pressões, algumas empresas buscam acordos para legitimar o uso de conteúdos. Esses acordos representam tentativas de equilibrar inovação com respeito à propriedade intelectual, evitando litígios prolongados.

Em 2025, empresas como a Anthropic sinalizam uma tendência para resoluções extrajudiciais, embora termos confidenciais limitem a transparência, essas iniciativas incluem parcerias com editoras para datasets licenciados, reduzindo riscos legais.

O Acordo da Anthropic com Autores

A Anthropic, criadora do Claude, em agosto de 2025, fechou um acordo com um grupo de escritores nos EUA para encerrar uma ação coletiva por violação de direitos autorais.

O processo, iniciado em 2024 por autores como Andrea Bartz, Charles Graeber e Kirk Wallace Johnson, alegava o uso de centenas de milhares de livros pirateados no treinamento do modelo. Embora detalhes financeiros não tenham sido divulgados, o acordo marca o primeiro grande entendimento nessa área, potencialmente influenciando negociações futuras e evitando danos potenciais de trilhões de dólares.

Antes do acordo, um juiz federal decidiu que o treinamento com livros sem permissão poderia ser legal sob a doutrina de uso justo, mas o acordo evitou uma compensação em larga escala. Essa resolução destaca uma tendência: empresas de IA optando por parcerias para acessar dados legalmente, como visto em acordos entre o New York Times e a OpenAI, que incluem remuneração por conteúdos jornalísticos.

As empresas de IA também estão preocupadas com ações coletivas massivas, onde autores buscam certificação para representar milhares de afetados. No contexto global, isso pode incentivar acordos semelhantes em jurisdições como a União Europeia, onde regulamentações mais rígidas sobre dados estão em vigor.

Ações Judiciais Contra o Uso Indevido de Conteúdos

Os processos judiciais proliferam, com escritores e veículos de mídia buscando proteção contra o scraping de dados por IAs. Esses casos testam limites legais e moldam jurisprudências emergentes, com decisões de 2025 favorecendo AI em alguns aspectos de uso justo, mas condenando violações diretas. A proliferação de litígios inclui mais de uma dúzia de ações nos EUA, abrangendo autores, jornais e artistas.

O Processo da Folha de São Paulo Contra a OpenAI

Em agosto de 2025, a Folha de S.Paulo ingressou com uma ação contra a OpenAI, acusando-a de concorrência desleal e violação de direitos autorais. O jornal alega que o ChatGPT usa seu acervo jornalístico para treinar modelos e reproduz reportagens na íntegra, burlando paywalls e distribuindo conteúdo restrito sem autorização.

A ação pede a imediata interrupção da coleta de dados e a exclusão de modelos construídos com materiais da Folha, sob pena de multas, marcando o primeiro caso de disputa por copyright de IA generativa no Brasil. Um juiz determinou segredo de justiça a pedido da OpenAI, ocultando detalhes sobre como a empresa processa dados, o que complica o debate público. Esse caso reflete uma tendência global: jornais como o Wall Street Journal e o New York Times moveram ações semelhantes nos EUA, acusando ferramentas de IA de copiar conteúdos protegidos.

No Brasil, o processo pode redefinir como IAs interagem com mídias locais, influenciando regulamentações sobre dados jornalísticos e testando a aplicação de leis nacionais em disputas internacionais. Especialistas destacam que a jurisdição brasileira, conhecida por ações judiciais ágeis, pode resultar em precedentes rápidos, contrastando com processos prolongados nos EUA.

Como Isso Afeta Leitores e Consumidores

A polêmica envolvendo IA e direitos autorais vai além de disputas legais entre empresas e criadores; ela impacta diretamente o que leitores e consumidores encontram no mercado cultural.

Quando modelos de inteligência artificial utilizam obras protegidas sem permissão, o resultado pode ser uma enxurrada de conteúdos padronizados, gerados em massa, que carecem da originalidade e profundidade de criações humanas. Isso ameaça a diversidade literária, reduzindo a riqueza de obras originais.

No jornalismo, o uso indevido de conteúdos por IA, como no caso da Folha de S.Paulo, compromete a sustentabilidade de redações que dependem de paywalls para financiar reportagens investigativas. Os leitores podem enfrentar um futuro com menos notícias confiáveis, já que ferramentas de IA reproduzem reportagens sem custear sua produção, enfraquecendo o jornalismo de qualidade.

Além disso, a capacidade de IAs generativas de replicarem estilos artísticos ou literários levanta preocupações sobre desinformação. Textos gerados automaticamente podem propagar erros de datasets piratas, como versões adulteradas de livros, ou criar narrativas enganosas que confundem os leitores. Para o público, isso significa um risco de consumir conteúdos menos autênticos, com um impacto cultural e informativo que será negativo e pobre a um longo prazo.

Perspectivas para o Futuro da IA em Relação aos Direitos Autorais

O futuro da IA e direitos autorais aponta para uma evolução regulatória, com leis adaptadas para acomodar inovações sem sacrificar criadores. A questão de direitos autorais pode ameaçar a indústria de IA, forçando transparência sobre fontes de treinamento e o pagamento de indenizações para o uso indevido.

No Brasil, debates no Congresso sugerem novas leis exigindo que big techs divulguem obras usadas, promovendo acordos remunerados. Um caminho seria tentar um equilíbrio via parcerias, como licenças para datasets, reduzindo os litígios. No entanto, sem regulamentações globais, violações persistirão, especialmente com IAs generativas desafiando conceitos de autoria.

Em 2025, com obras entrando em domínio público, IAs ganharão acesso legal a mais conteúdos, mas o foco permanecerá em proteger criações recentes. Relatórios do US Copyright Office enfatizam que obras puramente geradas por IA não são passíveis de copyrights, impulsionando debates sobre importância da autoria humana.

Na União Europeia, diretivas mais estritas podem inspirar leis internacionais, enquanto nos EUA, previsões apontam para leis federais de transparência em AI.

O avanço da IA dependerá de acordos éticos que valorizem tanto a inovação quanto os direitos dos criadores, levando a um ecossistema mais colaborativo e sustentável, onde compensações e transparência se tornem padrões.

Amante de livros, músicas e filmes desde que me conheço por gente.

Livreira há muitos anos.

Criadora e redatora chefe do Meu Momento Cultural.

A minha vontade de dividir essa paixão, me trouxe até aqui.